Lo que NUNCA debes hacer (y cómo hacerlo bien)

La IA Generativa es una ventana abierta a la productividad. Pero si se usa sin marcos de seguridad, puede convertirse en una fuga silenciosa de activos: datos personales, propiedad intelectual, credenciales, información financiera sensible… y confianza.

Además, en Europa el contexto regulatorio ya no es “algún día”: el AI Act entró en vigor el 1 de agosto de 2024 y se aplica de forma progresiva, con hitos importantes en 2025 (GPAI) y 2 de agosto de 2026 (aplicabilidad general y obligaciones de transparencia, entre otras).

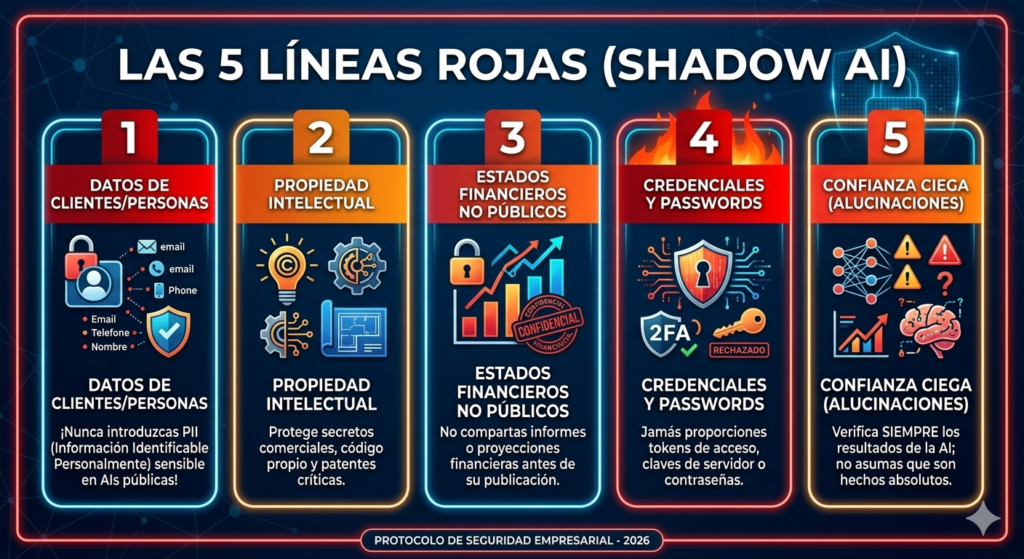

Las 5 Líneas Rojas (Shadow AI): lo que NUNCA debes hacer

1) Datos de clientes/personas (PII): no los subas a IA pública o gratuita

Nunca pegues o subas bases con nombres, DNI, emails, teléfonos, historiales médicos, evaluaciones de desempeño, etc.

Riesgo: incumplimientos graves de GDPR, sanciones, y ruptura de confianza. El GDPR regula el tratamiento de datos personales y exige principios como minimización, finalidad y seguridad.

Por qué importa especialmente con IA pública: en servicios “consumer”, tu contenido puede usarse para mejorar modelos salvo que configures controles/opt-out (según el proveedor). En el caso de OpenAI, el propio centro de ayuda indica que en servicios para individuos “podemos usar tu contenido para entrenar” y ofrece opción de exclusión.

Cómo hacerlo bien: aplica la Regla de las 3 “A” (más abajo) y usa entornos corporativos aprobados.

2) Propiedad intelectual crítica: no “entrenes al mundo” con tu ventaja competitiva

Nunca alimentes modelos con algoritmos propios, secretos comerciales, diseños internos, procedimientos únicos o “know-how” diferencial.

Riesgo: pérdida de ventaja competitiva (y, en casos, exposición accidental por copiado/pegado, reuso interno, logs, integraciones o errores humanos).

Cómo hacerlo bien: trabaja con abstracciones (estructura, criterios, patrones) y con repositorios internos + herramientas corporativas donde tengas control contractual y técnico (permisos, DLP, trazabilidad).

3) Estados financieros no públicos: cuidado con la información privilegiada

Evita subir reportes de ingresos, márgenes, previsiones o datos relevantes antes de su publicación oficial.

Riesgo: fuga de información sensible y potenciales implicaciones de cumplimiento (y reputacionales).

Cómo hacerlo bien: usa cifras agregadas, rangos o escenarios ficticios (“Caso A/B”), y valida con finanzas/compliance el nivel de compartición permitido.

4) Credenciales, passwords y llaves de API: ni por “un segundo”

Nunca pegues código que contenga tokens, llaves de API, contraseñas, certificados, cadenas de conexión o accesos a BBDD.

Riesgo: compromiso inmediato de sistemas.

Cómo hacerlo bien: reemplaza por placeholders:

API_KEY=***DB_HOST=<host>TOKEN=<redacted>

Y si necesitas ayuda con un error, comparte solo el mensaje de error, el contexto mínimo y un snippet sanitizado.

5) Confianza ciega: no des por bueno un dato numérico o una cita legal sin verificar

Nunca uses como “verdad” un número, una referencia jurídica o una afirmación factual sin comprobación.

Riesgo: decisiones erróneas, fallos de compliance, y documentos con apariencia profesional pero base falsa.

OpenAI ha explicado por qué los modelos pueden “alucinar” (producir respuestas plausibles pero incorrectas) y recomienda técnicas y procesos para mejorar exactitud (p.ej., RAG, validación contra fuentes, etc.).

Cómo hacerlo bien: regla simple: “si tiene números, nombres propios o consecuencias legales → verificación obligatoria”.

Protocolo de Uso Seguro: la Regla de las 3 “A” (antes de pulsar Enter)

A1) Anonimización

Sustituye identidades reales por etiquetas:

- “Cliente A”, “Proyecto X”, “Empleado 01”

La IA entiende el patrón sin conocer la identidad.

A2) Abstracción

Sube el concepto o la estructura, no el contenido sensible.

En vez de pegar un contrato entero, describe:

- “Tengo una cláusula de no competencia con X condiciones; ¿qué riesgos típicos debo revisar?”

En vez de compartir un excel de clientes, plantea: - “Tengo una tabla con 12 variables; ¿qué análisis recomendarías y qué sesgos debo vigilar?”

A3) Ambiente corporativo

Prioriza versiones Business/Enterprise aprobadas por tu organización (y sus equivalentes en tu stack). La clave no es el “logo”, es el marco de datos:

- OpenAI indica que por defecto no entrena con datos de negocio en sus ofertas empresariales.

- Microsoft documenta que en Microsoft 365 Copilot los prompts/respuestas y datos accesibles no se usan para entrenar modelos fundacionales.

- Google Workspace con Gemini comunica protecciones “enterprise-grade”, incluyendo que las “submissions” no se usan para entrenar modelos (según su FAQ para licencias).

Traducción práctica: si no estás en el entorno corporativo aprobado, juega como si estuvieras en una sala con paredes de cristal.

“Mapa rápido” por nivel de sensibilidad de la Información

| Nivel de sensibilidad | ¿Se puede usar IA generativa? | Condiciones de uso | Ejemplos típicos |

|---|---|---|---|

| Público | ✅ Sí | Revisar veracidad, sesgos y tono antes de publicar | Contenido web, artículos, información pública |

| Interno | ⚠️ Sí, con precaución | Solo en entornos corporativos aprobados + anonimización básica | Documentos internos, procesos generales |

| Confidencial | ⚠️ Uso restringido | Abstracción fuerte, controles de acceso (permisos/DLP) y revisión humana | Estrategia interna, análisis de negocio |

| Restringido / Crítico | ❌ No en IA generalista | Usar canales seguros y procesos específicos | PII, secretos empresariales, credenciales |

Checklist de Seguridad para el Empleado (antes de usar/publicar un resultado)

- ¿He anonimizado cualquier dato sensible?

- ¿He abstraído el contenido (estructura > contenido crítico)?

- ¿Estoy usando un entorno corporativo aprobado (no una versión pública/gratis)?

- ¿He verificado fuentes y datos numéricos (y guardado evidencias)?

- ¿El resultado respeta la voz, valores y límites de la marca?

- ¿He añadido el toque humano (criterio, contexto, decisión final)?

- ¿He cumplido la política interna de IA y, si aplica, he consultado a DPO/Compliance?

- Si hay datos personales “delicados” o alto riesgo: ¿debería hacerse una DPIA? (GDPR Art. 35)

Plantillas de prompts “seguros” (para no caer en Shadow AI)

1) Revisión de un texto sensible (sin pegarlo):

“Necesito revisar una cláusula sobre [tema]. Resume riesgos típicos, preguntas de control y una lista de verificación. Contexto: sector [X], país [Y]. No incluyas asesoría legal; quiero puntos a revisar.”

2) Análisis de feedback de clientes (anonimizado):

“Tengo 50 comentarios anonimizados (sin nombres). Extrae temas, sentimiento y 5 acciones recomendadas. Indica qué afirmaciones requieren validación con datos.”

3) Soporte técnico (sin secretos):

“Tengo este error [mensaje] en [stack]. Aquí un snippet sin credenciales. Propón hipótesis y pasos de diagnóstico.”

Conclusión

La seguridad no es el freno del coche, es lo que permite que el coche vaya rápido de forma segura. Cumplir con estas normas no solo protege a la organización, sino que legitima tu trabajo y te posiciona como un profesional responsable en la nueva economía del talento.

Si buscas optimizar la formación de tus empleados, puedes ponerte en contacto con nosotros.