Hoy la IA es omnipresente, pero su impacto es desigual. Según el Work Trend Index de Microsoft/LinkedIn, el 75% de los empleados ya utiliza IA, pero la mayoría lo hace fuera de los marcos oficiales de la empresa. Esto crea una «IA en la sombra» que, aunque demuestra entusiasmo, genera riesgos de seguridad, desigualdad en los criterios de calidad y una pérdida masiva de aprendizajes que no se comparten.

La cultura no es algo «blando» o accesorio; es el sistema operativo que decide si la IA nos hace más rápidos o simplemente más caóticos.

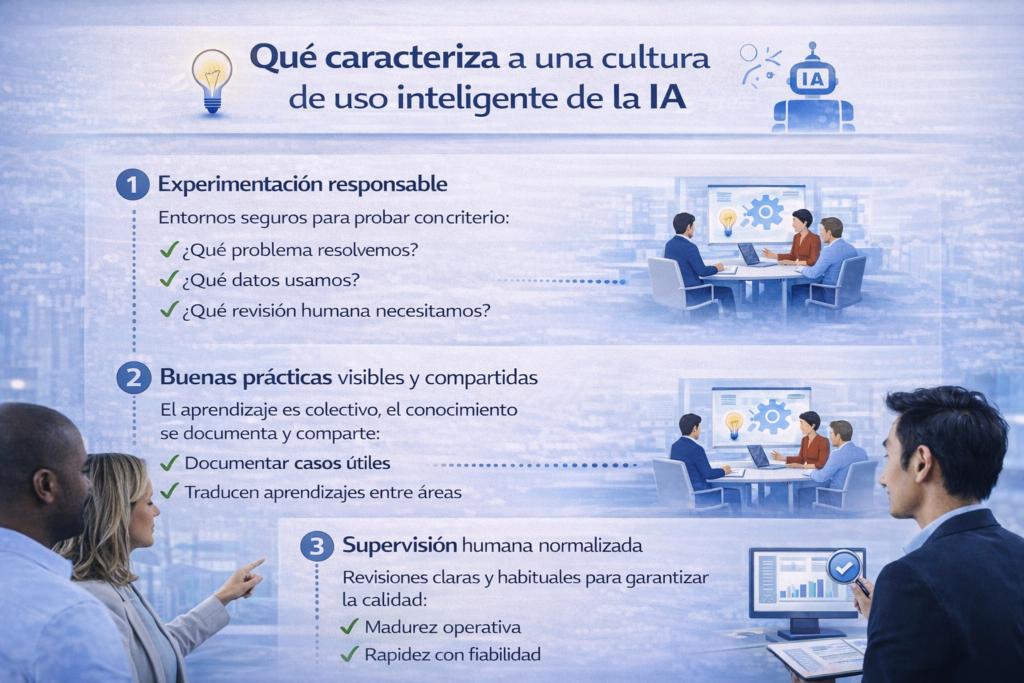

Los 3 Pilares de una Cultura de uso Inteligente

| Pilar | Definición Operativa | El objetivo |

| Experimentación Responsable | Probar con hipótesis, no por impulso. | Seguridad y aprendizaje compartido. |

| Prácticas Compartidas | El «know-how» no es individual, es patrimonio colectivo. | Evitar que la IA sea un compartimento estanco. |

| Supervisión Normalizada | Revisar no es desconfiar; es madurez. | Calidad técnica y rigor profesional. |

1. Experimentación responsable, no improvisación

Las organizaciones que avanzan mejor no son necesariamente las que controlan más, sino las que crean entornos seguros para probar con criterio. MIT Sloan Management Review subraya que las prácticas de IA responsable deben integrarse desde el inicio y que los equipos deben participar en ellas como parte de su trabajo cotidiano, no como una discusión paralela. Eso es una definición cultural, no solo técnica.

En la práctica, esto significa permitir la prueba, pero con preguntas claras: qué problema intentamos resolver, qué datos usamos, qué revisión humana requiere el resultado y qué límites no deben cruzarse. La cultura no reemplaza a la gobernanza; la vuelve operativa en el día a día.

2. Buenas prácticas visibles y compartidas

Una cultura madura evita que el conocimiento se quede encerrado en usuarios avanzados o en equipos pioneros. El aprendizaje se vuelve colectivo. Este punto es clave porque gran parte del valor de la IA surge cuando la organización aprende a repetir y mejorar usos útiles, no cuando acumula ejemplos aislados. McKinsey vincula el valor de la IA con prácticas de adopción y escalado, no solo con la disponibilidad de la tecnología.

Aquí L&D y RR. HH. tienen un papel decisivo: documentar casos, traducir aprendizajes entre áreas y ayudar a transformar experiencias individuales en capacidades compartidas.

3. Supervisión humana normalizada

La cultura de uso inteligente no trata la revisión humana como una excepción defensiva, sino como parte normal del proceso. McKinsey destaca que los high performers son más propensos a tener procesos definidos para decidir cómo y cuándo validar salidas de modelos con intervención humana. Eso no es solo una práctica de control; es una forma de madurez operativa.

En culturas inmaduras, la IA se usa como atajo. En culturas maduras, se usa como acelerador con criterio. La diferencia es que en el segundo caso nadie confunde rapidez con fiabilidad automática.

La IA como «Nueva Normalidad»

La cultura se vuelve inteligente cuando deja de ser una novedad. En las organizaciones líderes de 2026, la IA ya no es un «tema de innovación»; es parte del modo en que se gestiona la calidad, se desarrolla talento y se sirve al cliente.

«La tecnología no transforma por presencia; transforma por integración.»

La cultura define si la IA genera confianza o ansiedad

El componente emocional también importa. BCG, a partir de una encuesta global a 13.102 empleados en 15 países, mostró que la confianza en la IA ha crecido, pero también lo ha hecho el temor al desplazamiento laboral. En su actualización de 2025, BCG volvió a insistir en que las empresas que más valor están obteniendo de la IA son también las que impulsan programas de upskilling más ambiciosos. La lección es clara: la cultura de IA no se construye solo con mensajes de entusiasmo, sino con preparación real, claridad de expectativas y acompañamiento.

Cuando una organización no explica qué espera, qué protege y cómo piensa desarrollar capacidades, el uso de IA puede percibirse como una amenaza difusa. Cuando sí lo hace, la conversación cambia: la IA pasa de ser una fuente de incertidumbre a una herramienta integrada en una narrativa de aprendizaje y evolución profesional.

El verdadero salto cultural ocurre cuando la IA deja de percibirse como una innovación puntual y empieza a incorporarse al trabajo con naturalidad, pero sin banalizar sus riesgos. Esa combinación es la clave: normalización sin ingenuidad.

Normalizar significa que las personas saben dónde aportan valor, cómo pedir ayuda, cómo revisar resultados y qué responsabilidad conservan. Sin esa base, la IA queda atrapada entre dos extremos igual de improductivos: el entusiasmo sin criterio y la resistencia por desconfianza.

Conclusión

La cultura de uso inteligente de la IA no se decreta. Se construye. Se construye cuando la experimentación tiene guía, cuando las buenas prácticas se comparten, cuando la supervisión humana está clara y cuando RR. HH. y L&D convierten el acceso tecnológico en madurez distribuida.

¿En tu organización la IA sigue siendo una suma de iniciativas individuales o ya empieza a convertirse en un hábito compartido, responsable y alineado con el trabajo real?

Si buscas optimizar la formación de tus empleados, puedes ponerte en contacto con nosotros.